Datapool

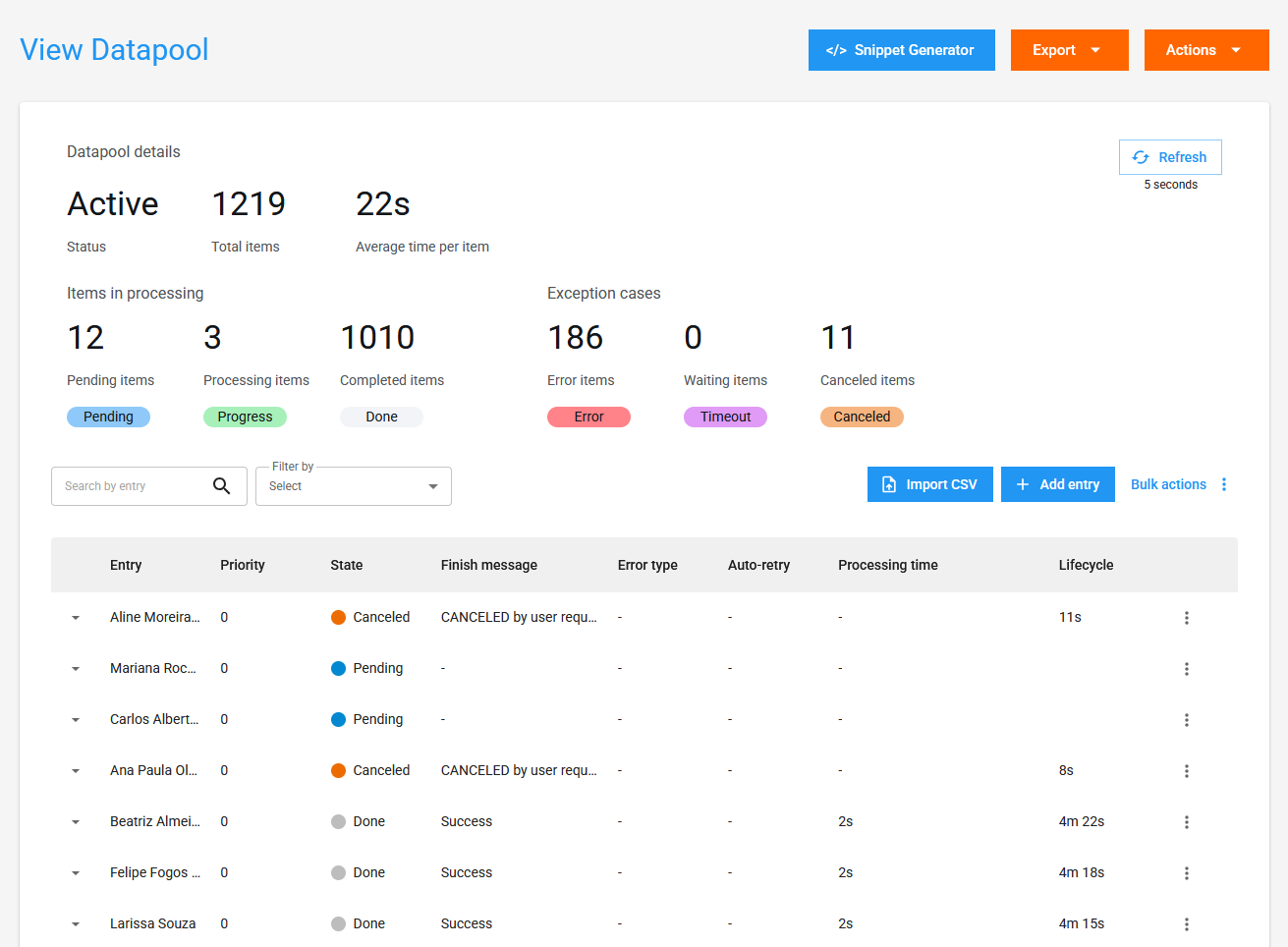

Ir a DatapoolEl Datapool es un módulo del BotCity Orchestrator que permite la gestión eficiente del procesamiento de lotes de elementos.

Mediante el Datapool, se puede controlar y gestionar con precisión la cola de elementos que deben procesarse, lo que lo convierte en un recurso esencial para las automatizaciones que procesan grandes volúmenes de datos.

Visión General¶

Características Principales¶

-

Procesamiento paralelo de elementos: Permite que varias tareas consuman elementos de una única cola en paralelo.

-

Reprocesamiento automático: Reinserta automáticamente en la cola los elementos procesados con errores para su reprocesamiento.

- Estandarización de datos: El esquema permite crear una estructura predefinida para los elementos, definiendo los campos esperados para cada elemento agregado.

- Activación de tareas: Activación automática de tareas para su ejecución, basada en la creación de nuevos elementos en la cola.

Principales Ventajas¶

- Abstracción de la complejidad: Elimina la necesidad de implementar lógica compleja en el código, ya que cuenta con gestión nativa para escenarios de consumo y reprocesamiento concurrentes.

- Gestión centralizada: Ofrece gestión centralizada directamente en BotCity Orchestrator, facilitando el control y la monitorización, y ya está integrado con otros recursos de la plataforma. Elimina la necesidad de depender de bases de datos externas y herramientas auxiliares.

- Integraciones simplificadas: Puede leer datos de cualquier base de datos y transformarlos en elementos del Datapool, añadiéndolos a la cola de procesamiento mediante API, SDK y archivos

.csv. Extraiga fácilmente los datos de procesamiento e intégrelos con sus plataformas de visualización de datos.

Casos de Uso¶

- Procesamiento de lotes de elementos: Ideal para automatizaciones que necesitan procesar un gran volumen de datos o lotes de elementos, como registros, actualizaciones y consultas.

- Escenarios productor/consumidor: Una excelente alternativa para escenarios donde una automatización genera demanda creando nuevos elementos en el Datapool, y otra automatización consume la cola y realiza el flujo de procesamiento de estos elementos.